全球工業自動化領域的領導者西門子工業自動化有限公司正式發布了其經典產品——S7-200CN可編程邏輯控制器(PLC)的全新樣本手冊。這一舉動在工控新聞與自動化控制設備領域引起了廣泛關注,標志著西門子對這款在中國市場享有盛譽、應用廣泛的“功勛”產品線的持續支持與優化。

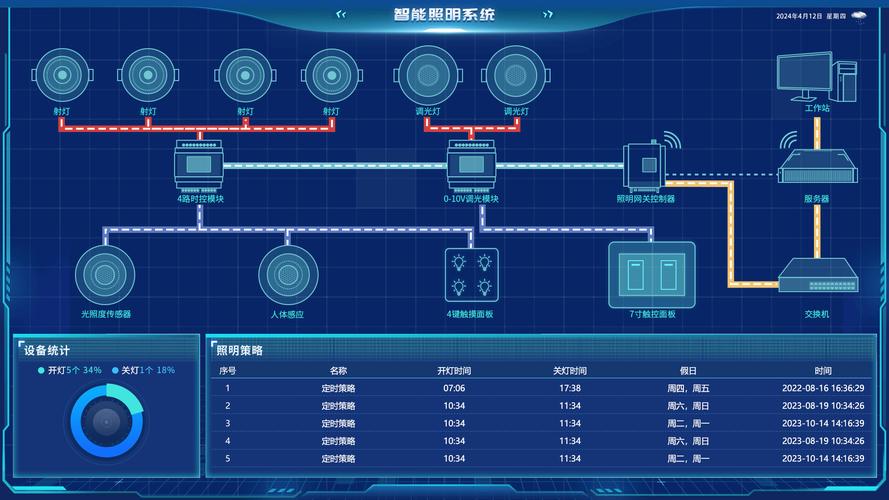

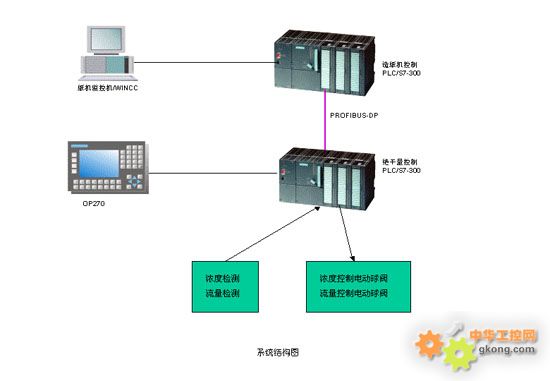

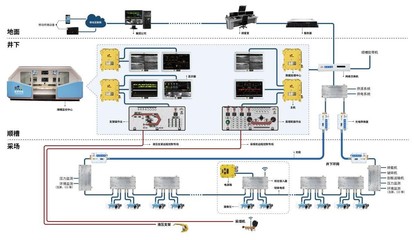

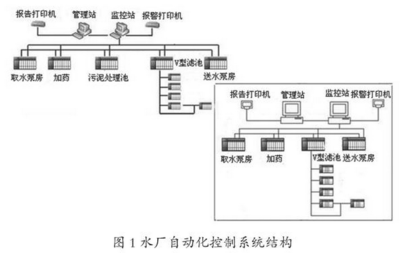

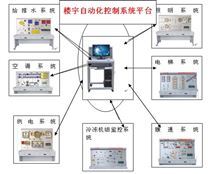

S7-200CN系列自推出以來,憑借其緊湊的設計、強大的功能、卓越的可靠性和極高的性價比,已成為中國眾多中小型自動化項目、設備配套及教學領域的首選控制器之一。它廣泛應用于紡織機械、包裝機械、暖通空調、電梯控制以及各類流水線設備中,為無數企業的自動化升級與智能化改造提供了堅實可靠的“大腦”。

此次發布的新樣本,并非僅僅是產品資料的簡單更新。據悉,新版樣本在內容組織和信息呈現上進行了系統性優化,旨在為用戶提供更清晰、更便捷的選型與應用指導。主要體現在以下幾個方面:

- 信息架構更清晰: 新樣本對產品功能特性、技術參數、模塊選型、通訊配置及附件信息進行了邏輯性更強的梳理,工程師可以更快速地定位所需信息,縮短項目規劃和設備選型的時間。

- 應用導向更突出: 樣本中可能增強了對典型應用場景和解決方案的展示,結合S7-200CN在離散控制、過程監控等方面的優勢,為用戶提供更直觀的參考案例。

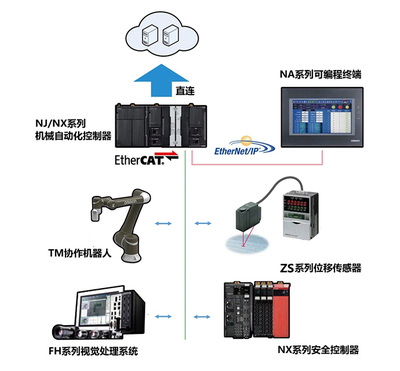

- 兼容性與升級路徑明確: 隨著西門子自動化產品體系的不斷發展,新樣本預計會進一步闡明S7-200CN與西門子更先進的S7-1200、S7-1500等系列產品的協作關系,以及面向未來的升級考量,幫助用戶構建可持續的自動化架構。

- 技術支持信息集成: 樣本中通常會整合最新的產品認證、軟件支持(如STEP 7-Micro/WIN)版本信息以及獲取技術支持的官方渠道,方便用戶一站式獲取資源。

在自動化技術日新月異的今天,西門子此次更新S7-200CN樣本,傳遞出幾個重要信號:體現了西門子對中國市場存量巨大且仍在穩定運行的S7-200CN系統用戶的高度負責,確保他們能持續獲得準確的產品與技術信息。也說明了在特定的應用領域和預算范圍內,成熟、穩定、經濟性高的解決方案依然擁有不可替代的生命力。這也是西門子“客戶至上”服務理念的體現,通過優化知識工具,賦能廣大工程師和最終用戶。

對于自動化系統集成商、設備制造商以及終端用戶而言,及時獲取并參考這份最新的官方樣本至關重要。它不僅是進行設備采購、庫存管理和項目設計的權威依據,也是保障系統穩定運行、高效維護的技術基石。

總而言之,西門子S7-200CN新樣本的發布,是一次對經典產品生命力的再確認,也是對龐大用戶群體的持續賦能。它將繼續攜手中國工業領域的伙伴,在提質、增效、降本的自動化道路上穩健前行,共同推動“中國制造”向更高水平邁進。